pytorch 如何打印网络回传梯度

需求:

打印梯度,检查网络学习情况

net = your_network().cuda()

def train():

...

outputs = net(inputs)

loss = criterion(outputs, targets)

loss.backward()

for name, parms in net.named_parameters():

print('-->name:', name, '-->grad_requirs:',parms.requires_grad, \

' -->grad_value:',parms.grad)

...

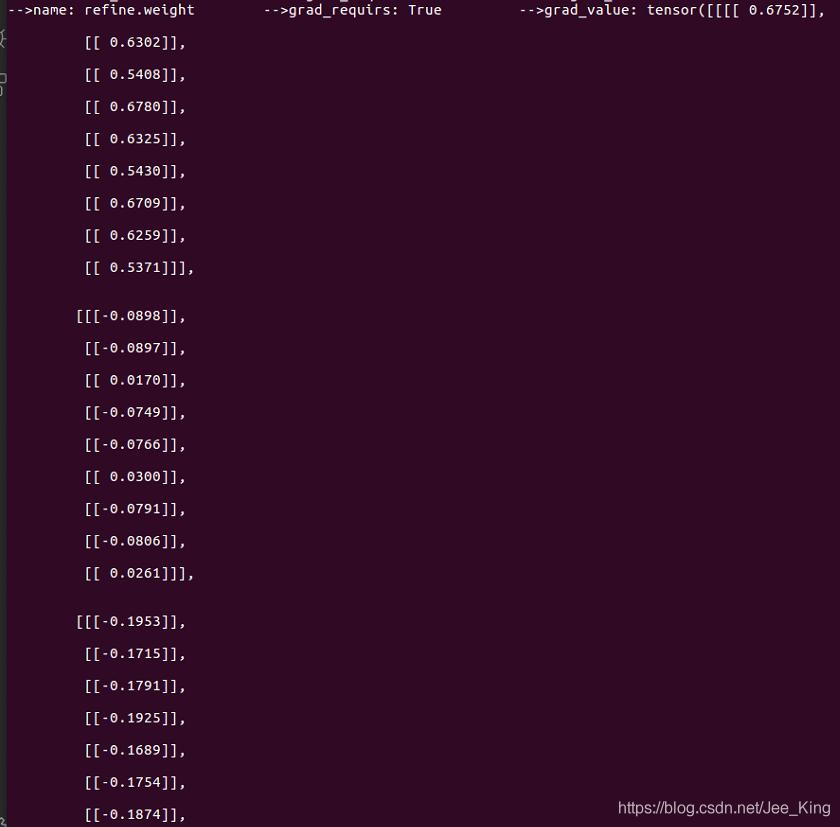

打印结果如下:

name表示网络参数的名字; parms.requires_grad 表示该参数是否可学习,是不是frozen的; parm.grad 打印该参数的梯度值。

补充:pytorch的梯度计算

看代码吧~

import torch

from torch.autograd import Variable

x = torch.Tensor([[1.,2.,3.],[4.,5.,6.]]) #grad_fn是None

x = Variable(x, requires_grad=True)

y = x + 2

z = y*y*3

out = z.mean()

#x->y->z->out

print(x)

print(y)

print(z)

print(out)

#结果:

tensor([[1., 2., 3.],

[4., 5., 6.]], requires_grad=True)

tensor([[3., 4., 5.],

[6., 7., 8.]], grad_fn=<AddBackward>)

tensor([[ 27., 48., 75.],

[108., 147., 192.]], grad_fn=<MulBackward>)

tensor(99.5000, grad_fn=<MeanBackward1>)

若是关于graph leaves求导的结果变量是一个标量,那么gradient默认为None,或者指定为“torch.Tensor([1.0])”

若是关于graph leaves求导的结果变量是一个向量,那么gradient是不能缺省的,要是和该向量同纬度的tensor

out.backward()

print(x.grad)

#结果:

tensor([[3., 4., 5.],

[6., 7., 8.]])

#如果是z关于x求导就必须指定gradient参数:

gradients = torch.Tensor([[2.,1.,1.],[1.,1.,1.]])

z.backward(gradient=gradients)

#若z不是一个标量,那么就先构造一个标量的值:L = torch.sum(z*gradient),再关于L对各个leaf Variable计算梯度

#对x关于L求梯度

x.grad

#结果:

tensor([[36., 24., 30.],

[36., 42., 48.]])

错误情况

z.backward()

print(x.grad)

#报错:RuntimeError: grad can be implicitly created only for scalar outputs只能为标量创建隐式变量

x1 = Variable(torch.Tensor([[1.,2.,3.],[4.,5.,6.]]))

x2 = Variable(torch.arange(4).view(2,2).type(torch.float), requires_grad=True)

c = x2.mm(x1)

c.backward(torch.ones_like(c))

# c.backward()

#RuntimeError: grad can be implicitly created only for scalar outputs

print(x2.grad)

从上面的例子中,out是常量,可以默认创建隐变量,如果反向传播的不是常量,要知道该矩阵的具体值,在网络中就是loss矩阵,方向传播的过程中就是拿该归一化的损失乘梯度来更新各神经元的参数。

看到一个博客这样说:loss = criterion(outputs, labels)对应loss += (label[k] - h) * (label[k] - h) / 2

就是求loss(其实我觉得这一步不用也可以,反向传播时用不到loss值,只是为了让我们知道当前的loss是多少)

我认为一定是要求loss的具体值,才能对比阈值进行分类,通过非线性激活函数,判断是否激活。

以上为个人经验,希望能给大家一个参考,也希望大家多多支持猪先飞。

相关文章

- 这篇文章主要介绍了js如何实现浏览器打印功能,文中示例代码非常详细,帮助大家更好的理解和学习,感兴趣的朋友可以了解下...2020-07-15

pytorch nn.Conv2d()中的padding以及输出大小方式

今天小编就为大家分享一篇pytorch nn.Conv2d()中的padding以及输出大小方式,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-04-27- 这篇文章主要介绍了PyTorch一小时掌握之迁移学习篇,本文给大家介绍的非常详细,对大家的学习或工作具有一定的参考借鉴价值,需要的朋友可以参考下...2021-09-08

Linux安装Pytorch1.8GPU(CUDA11.1)的实现

这篇文章主要介绍了Linux安装Pytorch1.8GPU(CUDA11.1)的实现,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起学习学习吧...2021-03-25- 这篇文章主要介绍了Pytorch之扩充tensor的操作,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2021-03-05

- 今天小编就为大家分享一篇pytorch 自定义卷积核进行卷积操作方式,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-05-06

- 这篇文章主要介绍了解决pytorch 交叉熵损失输出为负数的问题,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-07-08

pytorch绘制并显示loss曲线和acc曲线,LeNet5识别图像准确率

今天小编就为大家分享一篇pytorch绘制并显示loss曲线和acc曲线,LeNet5识别图像准确率,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-05-02- 这篇文章主要介绍了浅谈关于如何检测iOS14本地网络权限的一些思路,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起学习学习吧...2020-12-08

- 这篇文章主要介绍了pytorch 实现冻结部分参数训练另一部分,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2021-03-27

- 这篇文章主要介绍了C#实现启用与禁用本地网络的方式,结合实例形式总结分析了使用Hnetcfg.dll、Shell32.dll及setupapi.dll三种启用与禁用本地网络的操作方法,需要的朋友可以参考下...2020-06-25

- 这篇文章主要介绍了c#如何获取已安装的打印机并调用打印文件,帮助大家更好的理解和使用c#,感兴趣的朋友可以了解下...2020-12-08

- 这篇文章主要为大家详细介绍了vue实现页面打印自动分页的两种方法,文中示例代码介绍的非常详细,具有一定的参考价值,感兴趣的小伙伴们可以参考一下...2021-09-29

从Pytorch模型pth文件中读取参数成numpy矩阵的操作

这篇文章主要介绍了从Pytorch模型pth文件中读取参数成numpy矩阵的操作,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2021-03-04Pytorch 的损失函数Loss function使用详解

今天小编就为大家分享一篇Pytorch 的损失函数Loss function使用详解,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-05-02- A789使用过程中,一般有两种途径满足上网的需求,一是通过手机卡上网,一是通过周边存在的无线网络上网。不论上网的速度、还是从需求的费用看,通过无线网络上网都具有绝对的...2016-09-20

- 今天小编就为大家分享一篇pytorch中的上采样以及各种反操作,求逆操作详解,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-04-30

Springboot+MDC+traceId日志中打印唯一traceId

本文主要介绍了Springboot+MDC+traceId日志中打印唯一traceId,文中通过示例代码介绍的非常详细,具有一定的参考价值,感兴趣的小伙伴们可以参考一下...2021-10-17- 这篇文章主要介绍了基于Pytorch版yolov5的滑块验证码破解思路详解,本文给大家介绍的非常详细,对大家的学习或工作具有一定的参考借鉴价值,需要的朋友可以参考下...2021-02-25

pytorch中交叉熵损失(nn.CrossEntropyLoss())的计算过程详解

今天小编就为大家分享一篇pytorch中交叉熵损失(nn.CrossEntropyLoss())的计算过程详解,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-05-02