Spark集群框架的搭建与入门

一、Spark概述

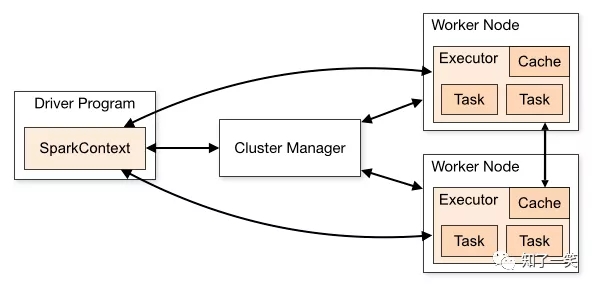

运行结构

Driver

运行Spark的Applicaion中main()函数,会创建SparkContext,SparkContext负责和Cluster-Manager进行通信,并负责申请资源、任务分配和监控等。

ClusterManager

负责申请和管理在WorkerNode上运行应用所需的资源,可以高效地在一个计算节点到数千个计算节点之间伸缩计算,目前包括Spark原生的ClusterManager、ApacheMesos和HadoopYARN。

Executor

Application运行在WorkerNode上的一个进程,作为工作节点负责运行Task任务,并且负责将数据存在内存或者磁盘上,每个 Application都有各自独立的一批Executor,任务间相互独立。

二、环境部署

1、Scala环境

安装包管理

[root@hop01 opt]# tar -zxvf scala-2.12.2.tgz [root@hop01 opt]# mv scala-2.12.2 scala2.12

配置变量

[root@hop01 opt]# vim /etc/profile export SCALA_HOME=/opt/scala2.12 export PATH=$PATH:$SCALA_HOME/bin [root@hop01 opt]# source /etc/profile

版本查看

[root@hop01 opt]# scala -version

Scala环境需要部署在Spark运行的相关服务节点上。

2、Spark基础环境

安装包管理

[root@hop01 opt]# tar -zxvf spark-2.1.1-bin-hadoop2.7.tgz [root@hop01 opt]# mv spark-2.1.1-bin-hadoop2.7 spark2.1

配置变量

[root@hop01 opt]# vim /etc/profile export SPARK_HOME=/opt/spark2.1 export PATH=$PATH:$SPARK_HOME/bin [root@hop01 opt]# source /etc/profile

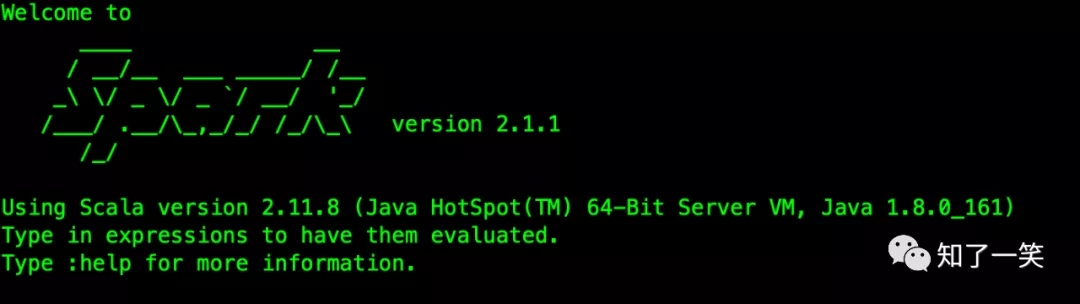

版本查看

[root@hop01 opt]# spark-shell

3、Spark集群配置

服务节点

[root@hop01 opt]# cd /opt/spark2.1/conf/ [root@hop01 conf]# cp slaves.template slaves [root@hop01 conf]# vim slaves hop01 hop02 hop03

环境配置

[root@hop01 conf]# cp spark-env.sh.template spark-env.sh [root@hop01 conf]# vim spark-env.sh export JAVA_HOME=/opt/jdk1.8 export SCALA_HOME=/opt/scala2.12 export SPARK_MASTER_IP=hop01 export SPARK_LOCAL_IP=安装节点IP export SPARK_WORKER_MEMORY=1g export HADOOP_CONF_DIR=/opt/hadoop2.7/etc/hadoop

注意SPARK_LOCAL_IP的配置。

4、Spark启动

依赖Hadoop相关环境,所以要先启动。

启动:/opt/spark2.1/sbin/start-all.sh 停止:/opt/spark2.1/sbin/stop-all.sh

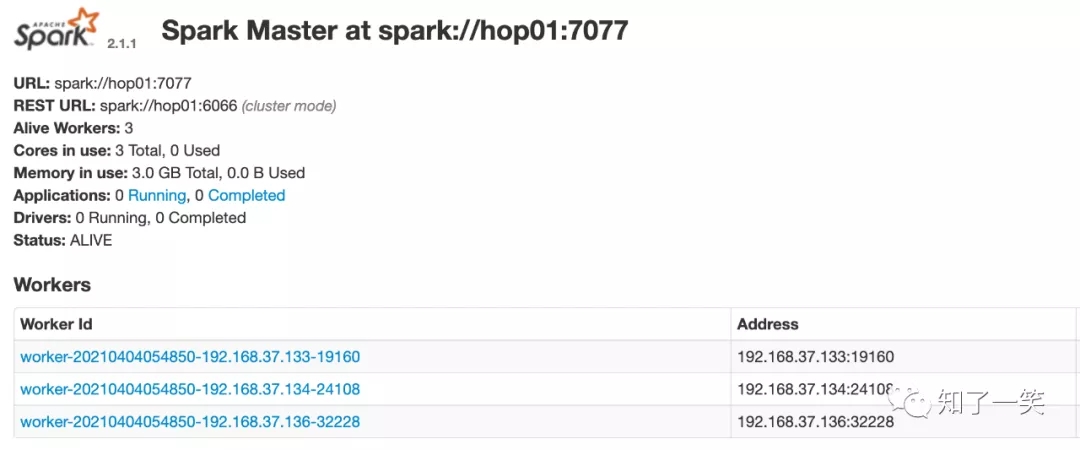

这里在主节点会启动两个进程:Master和Worker,其他节点只启动一个Worker进程。

5、访问Spark集群

默认端口是:8080。

http://hop01:8080/

运行基础案例:

[root@hop01 spark2.1]# cd /opt/spark2.1/ [root@hop01 spark2.1]# bin/spark-submit --class org.apache.spark.examples.SparkPi --master local examples/jars/spark-examples_2.11-2.1.1.jar 运行结果:Pi is roughly 3.1455357276786384

三、开发案例

1、核心依赖

依赖Spark2.1.1版本:

<dependency> <groupId>org.apache.spark</groupId> <artifactId>spark-core_2.11</artifactId> <version>2.1.1</version> </dependency>

引入Scala编译插件:

<plugin> <groupId>net.alchim31.maven</groupId> <artifactId>scala-maven-plugin</artifactId> <version>3.2.2</version> <executions> <execution> <goals> <goal>compile</goal> <goal>testCompile</goal> </goals> </execution> </executions> </plugin>

2、案例代码开发

读取指定位置的文件,并输出文件内容单词统计结果。

@RestController

public class WordWeb implements Serializable {

@GetMapping("/word/web")

public String getWeb (){

// 1、创建Spark的配置对象

SparkConf sparkConf = new SparkConf().setAppName("LocalCount")

.setMaster("local[*]");

// 2、创建SparkContext对象

JavaSparkContext sc = new JavaSparkContext(sparkConf);

sc.setLogLevel("WARN");

// 3、读取测试文件

JavaRDD lineRdd = sc.textFile("/var/spark/test/word.txt");

// 4、行内容进行切分

JavaRDD wordsRdd = lineRdd.flatMap(new FlatMapFunction() {

@Override

public Iterator call(Object obj) throws Exception {

String value = String.valueOf(obj);

String[] words = value.split(",");

return Arrays.asList(words).iterator();

}

});

// 5、切分的单词进行标注

JavaPairRDD wordAndOneRdd = wordsRdd.mapToPair(new PairFunction() {

@Override

public Tuple2 call(Object obj) throws Exception {

//将单词进行标记:

return new Tuple2(String.valueOf(obj), 1);

}

});

// 6、统计单词出现次数

JavaPairRDD wordAndCountRdd = wordAndOneRdd.reduceByKey(new Function2() {

@Override

public Object call(Object obj1, Object obj2) throws Exception {

return Integer.parseInt(obj1.toString()) + Integer.parseInt(obj2.toString());

}

});

// 7、排序

JavaPairRDD sortedRdd = wordAndCountRdd.sortByKey();

List<Tuple2> finalResult = sortedRdd.collect();

// 8、结果打印

for (Tuple2 tuple2 : finalResult) {

System.out.println(tuple2._1 + " ===> " + tuple2._2);

}

// 9、保存统计结果

sortedRdd.saveAsTextFile("/var/spark/output");

sc.stop();

return "success" ;

}

}

打包执行结果:

四、源代码地址

GitHub·地址

https://github.com/cicadasmile/big-data-parent

GitEE·地址

https://gitee.com/cicadasmile/big-data-parent

以上就是Spark集群框架的搭建与入门的详细内容,更多关于Spark集群框架的搭建的资料请关注猪先飞其它相关文章!

相关文章

- 这篇文章主要介绍了Linux环境下nginx搭建简易图片服务器,需要的朋友可以参考下...2016-01-27

- 下面小编就为大家带来一篇Angularjs---项目搭建图文教程。小编觉得挺不错的,现在就分享给大家,也给大家做个参考。一起跟随小编过来看看吧...2016-07-25

- 这篇文章主要介绍了前端自动化开发之Node.js环境搭建的相关资料,文中介绍的非常详细,对大家学习或者使用node.js具有一定的参考价值,需要的朋友们下面来一起看看吧。...2017-04-03

- 这篇文章主要给大家介绍了关于node.js利用express自动搭建项目的相关资料,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起学习学习吧...2021-04-09

- 这篇文章主要介绍了phpstudy2020搭建站点的实现示例,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起学习学习吧...2020-10-30

- 这篇文章主要给大家介绍了关于如何使用Vim搭建Lua开发环境的相关资料,文中通过图文介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面来一起学习学习吧...2020-06-30

pyspark操作hive分区表及.gz.parquet和part-00000文件压缩问题

这篇文章主要介绍了pyspark操作hive分区表及.gz.parquet和part-00000文件压缩问题,针对问题整理了spark操作hive表的几种方式,需要的朋友可以参考下...2021-08-25- 这篇文章主要介绍了Python Django搭建文件下载服务器的实现,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起学习学习吧...2021-05-10

- 这篇文章主要介绍了快速使用Bootstrap搭建传送带的相关资料,非常具有参考借鉴价值,需要的朋友可以参考下...2016-05-09

- 这篇文章主要介绍了微信小程序 window_x64环境搭建的相关资料,需要的朋友可以参考下...2016-10-02

- 将 golang 打包为 WASM,通常有两种打包方式,一种是 golang 自带的,另外是使用 tinygo ,接下来通过本文给大家介绍golang语言中wasm 环境搭建的过程,感兴趣的朋友一起看看吧...2021-11-10

- 这篇文章主要介绍了MySQL 有关MHA搭建与切换的几个错误log汇总,帮助大家更好的理解和使用MySQL,感兴趣的朋友可以了解下...2020-12-22

- 这篇文章主要介绍了Python3 虚拟开发环境搭建过程,本文通过图文实例代码相结合给大家介绍的非常详细,具有一定的参考借鉴价值,需要的朋友可以参考下...2020-04-30

- 这篇文章主要介绍了shell 脚本自动搭建nfs服务的方法示例,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起学习学习吧...2020-07-11

- php怎么样搭建本地服务器?小编分享的这篇文章详细介绍了php搭建本地服务器的步骤,不会的同学可以看看本文,按照步骤一步一步来,一定可以成功的。 网站程序写完之后,都...2017-07-06

- 这篇文章主要介绍了详解基于Scrapy的IP代理池搭建,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起学习学习吧...2020-09-29

- 这篇文章主要介绍了微信公众平台开发教程(三) 基础框架搭建,具有一定的参考价值,有需要的可以了解一下。...2020-06-25

- 为了便于操作,使用pyspark时我们通常将数据转为DataFrame的形式来完成清洗和分析动作。那么你知道pyspark创建DataFrame有几种方法吗,下面就一起来了解一下...2021-05-17

- DNSmasq是一个小巧且方便地用于配置DNS和DHCP的工具,适用于小型网络,它提供了DNS功能和可选择的DHCP功能。它服务那些只在本地适用的域名,这些域名是不会在全球的DNS服务...2016-10-10

linux 之centos7搭建mysql5.7.29的详细过程

这篇文章主要介绍了linux 之centos7搭建mysql5.7.29的详细过程,本文通过图文并茂的形式给大家介绍的非常详细,对大家的学习或工作具有一定的参考借鉴价值,需要的朋友可以参考下...2020-05-13