Pytorch 搭建分类回归神经网络并用GPU进行加速的例子

更新时间:2020年4月27日 21:21 点击:2039

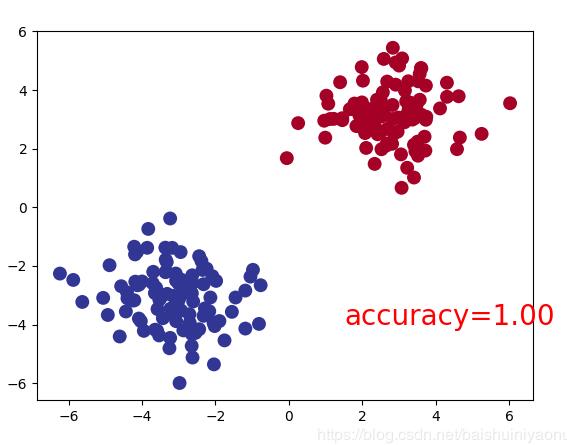

分类网络

import torch

import torch.nn.functional as F

from torch.autograd import Variable

import matplotlib.pyplot as plt

# 构造数据

n_data = torch.ones(100, 2)

x0 = torch.normal(3*n_data, 1)

x1 = torch.normal(-3*n_data, 1)

# 标记为y0=0,y1=1两类标签

y0 = torch.zeros(100)

y1 = torch.ones(100)

# 通过.cat连接数据

x = torch.cat((x0, x1), 0).type(torch.FloatTensor)

y = torch.cat((y0, y1), 0).type(torch.LongTensor)

# .cuda()会将Variable数据迁入GPU中

x, y = Variable(x).cuda(), Variable(y).cuda()

# plt.scatter(x.data.cpu().numpy()[:, 0], x.data.cpu().numpy()[:, 1], c=y.data.cpu().numpy(), s=100, lw=0, cmap='RdYlBu')

# plt.show()

# 网络构造方法一

class Net(torch.nn.Module):

def __init__(self, n_feature, n_hidden, n_output):

super(Net, self).__init__()

# 隐藏层的输入和输出

self.hidden1 = torch.nn.Linear(n_feature, n_hidden)

self.hidden2 = torch.nn.Linear(n_hidden, n_hidden)

# 输出层的输入和输出

self.out = torch.nn.Linear(n_hidden, n_output)

def forward(self, x):

x = F.relu(self.hidden2(self.hidden1(x)))

x = self.out(x)

return x

# 初始化一个网络,1个输入层,10个隐藏层,1个输出层

net = Net(2, 10, 2)

# 网络构造方法二

'''

net = torch.nn.Sequential(

torch.nn.Linear(2, 10),

torch.nn.Linear(10, 10),

torch.nn.ReLU(),

torch.nn.Linear(10, 2),

)

'''

# .cuda()将网络迁入GPU中

net.cuda()

# 配置网络优化器

optimizer = torch.optim.SGD(net.parameters(), lr=0.2)

# SGD: torch.optim.SGD(net.parameters(), lr=0.01)

# Momentum: torch.optim.SGD(net.parameters(), lr=0.01, momentum=0.8)

# RMSprop: torch.optim.RMSprop(net.parameters(), lr=0.01, alpha=0.9)

# Adam: torch.optim.Adam(net.parameters(), lr=0.01, betas=(0.9, 0.99))

loss_func = torch.nn.CrossEntropyLoss()

# 动态可视化

plt.ion()

plt.show()

for t in range(300):

print(t)

out = net(x)

loss = loss_func(out, y)

optimizer.zero_grad()

loss.backward()

optimizer.step()

if t % 5 == 0:

plt.cla()

prediction = torch.max(F.softmax(out, dim=0), 1)[1].cuda()

# GPU中的数据无法被matplotlib利用,需要用.cpu()将数据从GPU中迁出到CPU中

pred_y = prediction.data.cpu().numpy().squeeze()

target_y = y.data.cpu().numpy()

plt.scatter(x.data.cpu().numpy()[:, 0], x.data.cpu().numpy()[:, 1], c=pred_y, s=100, lw=0, cmap='RdYlBu')

accuracy = sum(pred_y == target_y) / 200

plt.text(1.5, -4, 'accuracy=%.2f' % accuracy, fontdict={'size':20, 'color':'red'})

plt.pause(0.1)

plt.ioff()

plt.show()

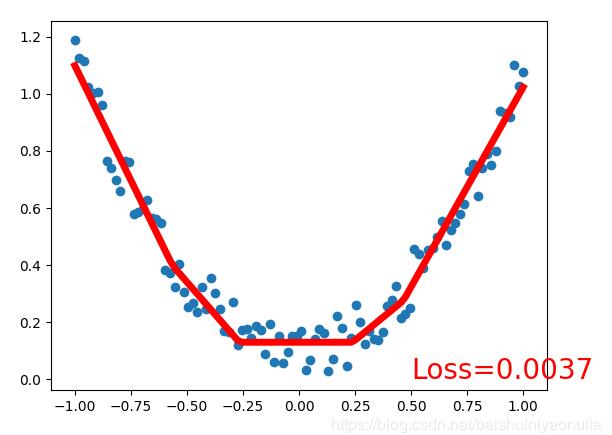

回归网络

import torch

import torch.nn.functional as F

from torch.autograd import Variable

import matplotlib.pyplot as plt

# 构造数据

x = torch.unsqueeze(torch.linspace(-1,1,100), dim=1)

y = x.pow(2) + 0.2*torch.rand(x.size())

# .cuda()会将Variable数据迁入GPU中

x, y = Variable(x).cuda(), Variable(y).cuda()

# plt.scatter(x.data.numpy(), y.data.numpy())

# plt.show()

# 网络构造方法一

class Net(torch.nn.Module):

def __init__(self, n_feature, n_hidden, n_output):

super(Net, self).__init__()

# 隐藏层的输入和输出

self.hidden = torch.nn.Linear(n_feature, n_hidden)

# 输出层的输入和输出

self.predict = torch.nn.Linear(n_hidden, n_output)

def forward(self, x):

x = F.relu(self.hidden(x))

x = self.predict(x)

return x

# 初始化一个网络,1个输入层,10个隐藏层,1个输出层

net = Net(1, 10, 1)

# 网络构造方法二

'''

net = torch.nn.Sequential(

torch.nn.Linear(1, 10),

torch.nn.ReLU(),

torch.nn.Linear(10, 1),

)

'''

# .cuda()将网络迁入GPU中

net.cuda()

# 配置网络优化器

optimizer = torch.optim.SGD(net.parameters(), lr=0.5)

# SGD: torch.optim.SGD(net.parameters(), lr=0.01)

# Momentum: torch.optim.SGD(net.parameters(), lr=0.01, momentum=0.8)

# RMSprop: torch.optim.RMSprop(net.parameters(), lr=0.01, alpha=0.9)

# Adam: torch.optim.Adam(net.parameters(), lr=0.01, betas=(0.9, 0.99))

loss_func = torch.nn.MSELoss()

# 动态可视化

plt.ion()

plt.show()

for t in range(300):

prediction = net(x)

loss = loss_func(prediction, y)

optimizer.zero_grad()

loss.backward()

optimizer.step()

if t % 5 == 0 :

plt.cla()

# GPU中的数据无法被matplotlib利用,需要用.cpu()将数据从GPU中迁出到CPU中

plt.scatter(x.data.cpu().numpy(), y.data.cpu().numpy())

plt.plot(x.data.cpu().numpy(), prediction.data.cpu().numpy(), 'r-', lw=5)

plt.text(0.5, 0, 'Loss=%.4f' % loss.item(), fontdict={'size':20, 'color':'red'})

plt.pause(0.1)

plt.ioff()

plt.show()

以上这篇Pytorch 搭建分类回归神经网络并用GPU进行加速的例子就是小编分享给大家的全部内容了,希望能给大家一个参考,也希望大家多多支持猪先飞。

相关文章

pytorch nn.Conv2d()中的padding以及输出大小方式

今天小编就为大家分享一篇pytorch nn.Conv2d()中的padding以及输出大小方式,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-04-27- 本文实例讲述了JS+CSS实现分类动态选择及移动功能效果代码。分享给大家供大家参考,具体如下:这是一个类似选项卡功能的选择插件,与普通的TAb区别是加入了动画效果,多用于商品类网站,用作商品分类功能,不过其它网站也可以用,...2015-10-21

- 这篇文章主要介绍了PyTorch一小时掌握之迁移学习篇,本文给大家介绍的非常详细,对大家的学习或工作具有一定的参考借鉴价值,需要的朋友可以参考下...2021-09-08

Linux安装Pytorch1.8GPU(CUDA11.1)的实现

这篇文章主要介绍了Linux安装Pytorch1.8GPU(CUDA11.1)的实现,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起学习学习吧...2021-03-25- 无限级分类在开发中经常使用,例如:部门结构、文章分类。无限级分类的难点在于“输出”和“查询”,例如 将文章分类输出为<ul>列表形式; 查找分类A下面所有分类包含的文章。1.实现原理 几种常见的实现方法,各有利弊。其中...2015-10-23

- 在一些复杂的系统中,要求对信息栏目进行无限级的分类,以增强系统的灵活性。那么PHP是如何实现无限级分类的呢?我们在本文中使用递归算法并结合mysql数据表实现无限级分类。 递归,简单的说就是一段程序代码的重复调用,当把...2015-10-23

- 这篇文章主要介绍了Pytorch之扩充tensor的操作,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2021-03-05

- 今天小编就为大家分享一篇pytorch 自定义卷积核进行卷积操作方式,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-05-06

- 这篇文章主要介绍了解决pytorch 交叉熵损失输出为负数的问题,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-07-08

- ecshop商品无限级分类代码 function cat_options($spec_cat_id, $arr) { static $cat_options = array(); if (isset($cat_options[$spec_cat_id]))...2016-11-25

pytorch绘制并显示loss曲线和acc曲线,LeNet5识别图像准确率

今天小编就为大家分享一篇pytorch绘制并显示loss曲线和acc曲线,LeNet5识别图像准确率,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-05-02- 这篇文章主要介绍了pytorch 实现冻结部分参数训练另一部分,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2021-03-27

从Pytorch模型pth文件中读取参数成numpy矩阵的操作

这篇文章主要介绍了从Pytorch模型pth文件中读取参数成numpy矩阵的操作,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2021-03-04Pytorch 的损失函数Loss function使用详解

今天小编就为大家分享一篇Pytorch 的损失函数Loss function使用详解,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-05-02- 一、数据库设计 -- -- Table structure for table `category` -- CREATE TABLE `category` ( `id` int(11) NOT NULL auto_increment, `catpath` varchar(255) default NULL, `name` varchar(255) default NULL...2015-11-08

- 今天小编就为大家分享一篇pytorch中的上采样以及各种反操作,求逆操作详解,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-04-30

- 今天小编就为大家分享一篇Pytorch实现LSTM和GRU示例,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-04-27

- 这篇文章主要介绍了基于Pytorch版yolov5的滑块验证码破解思路详解,本文给大家介绍的非常详细,对大家的学习或工作具有一定的参考借鉴价值,需要的朋友可以参考下...2021-02-25

- 这篇文章主要介绍了Python深度学习之简单实现猫狗图像分类,文中有非常详细的代码示例,对正在学习python的小伙伴们有非常好的帮助,需要的朋友可以参考下...2021-04-29

pytorch中交叉熵损失(nn.CrossEntropyLoss())的计算过程详解

今天小编就为大家分享一篇pytorch中交叉熵损失(nn.CrossEntropyLoss())的计算过程详解,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧...2020-05-02